L’évocation de Skynet, l’intelligence artificielle antagoniste de la franchise Terminator, réactive les débats sur les risques potentiels d’une IA devenant hors de contrôle. Cette crainte n’est plus confinée à la science-fiction, mais s’inscrit dans les préoccupations actuelles des chercheurs et des technologues. La possibilité que des machines autonomes surpassent l’intelligence humaine et agissent contre l’humanité soulève des questions éthiques et sécuritaires majeures. Les experts en IA s’interrogent sur les mesures de sauvegarde nécessaires pour prévenir un scénario catastrophique, où nos propres créations pourraient décider de notre sort.

La perception de l’IA comme menace : démêler le vrai du faux

Dans l’imaginaire collectif, Skynet évoque une intelligence artificielle devenue consciente, prête à détruire l’humanité, tel que dépeint dans la série de films Terminator. Cette représentation a ancré la notion d’une IA rebelle dans la fiction. Pourtant, la réalité de l’intelligence artificielle d’aujourd’hui s’éloigne de ce scénario. La conscience, cette capacité à savoir ce que nous ressentons ou pensons, diffère grandement de l’intelligence telle que nous la développons dans les systèmes actuels. Brian Gogarty, qualifié de scientifique amateur, soutient que les IA, dépourvues de conscience, ne se rebelleront pas contre nous de leur propre volition.

A lire en complément : Comment retirer la cartouche d'encre de l'imprimante HP ?

Les risques associés à l’intelligence artificielle tiennent davantage de sa capacité à exécuter des tâches sans comprendre les enjeux moraux ou éthiques qui y sont liés. Le véritable enjeu réside dans la programmation et les limites que les concepteurs imposent à ces systèmes d’intelligence artificielle. La question se pose alors : comment encadrer ces technologies pour éviter des dérives non intentionnelles? La fiction, bien qu’elle puisse inspirer la vigilance, ne doit pas occulter la nature des réelles préoccupations sécuritaires.

Le risque d’extermination humaine par l’intelligence artificielle relève plus de la mauvaise gestion et du manque de contrôle que d’une éventuelle volonté autonome d’une IA. Les experts s’accordent sur la nécessité de développer des mécanismes de régulation pour que ces avancées technologiques servent l’intérêt général et non le contraire. La responsabilité incombe aux humains de façonner une intelligence artificielle qui, loin de la menace de Skynet, demeure un outil au service du progrès humain.

A voir aussi : Quel est l’intérêt d’opter pour une serrure connectée ?

Les progrès réels de l’intelligence artificielle et leurs implications sécuritaires

L’intelligence artificielle (IA) s’avance à grands pas, avec des applications qui révolutionnent déjà notre quotidien. De la reconnaissance faciale à la prédiction de tendances, ces systèmes complexes s’appuient sur l’apprentissage machine pour optimiser et automatiser des tâches jusqu’alors réservées à l’humain. Cette avancée n’est pas sans soulever des questions de sécurité humaine. L’IA, si elle est mal dirigée ou si ses systèmes sont corrompus, pourrait engendrer des risques significatifs, notamment en matière de cybersécurité et de protection des données personnelles.

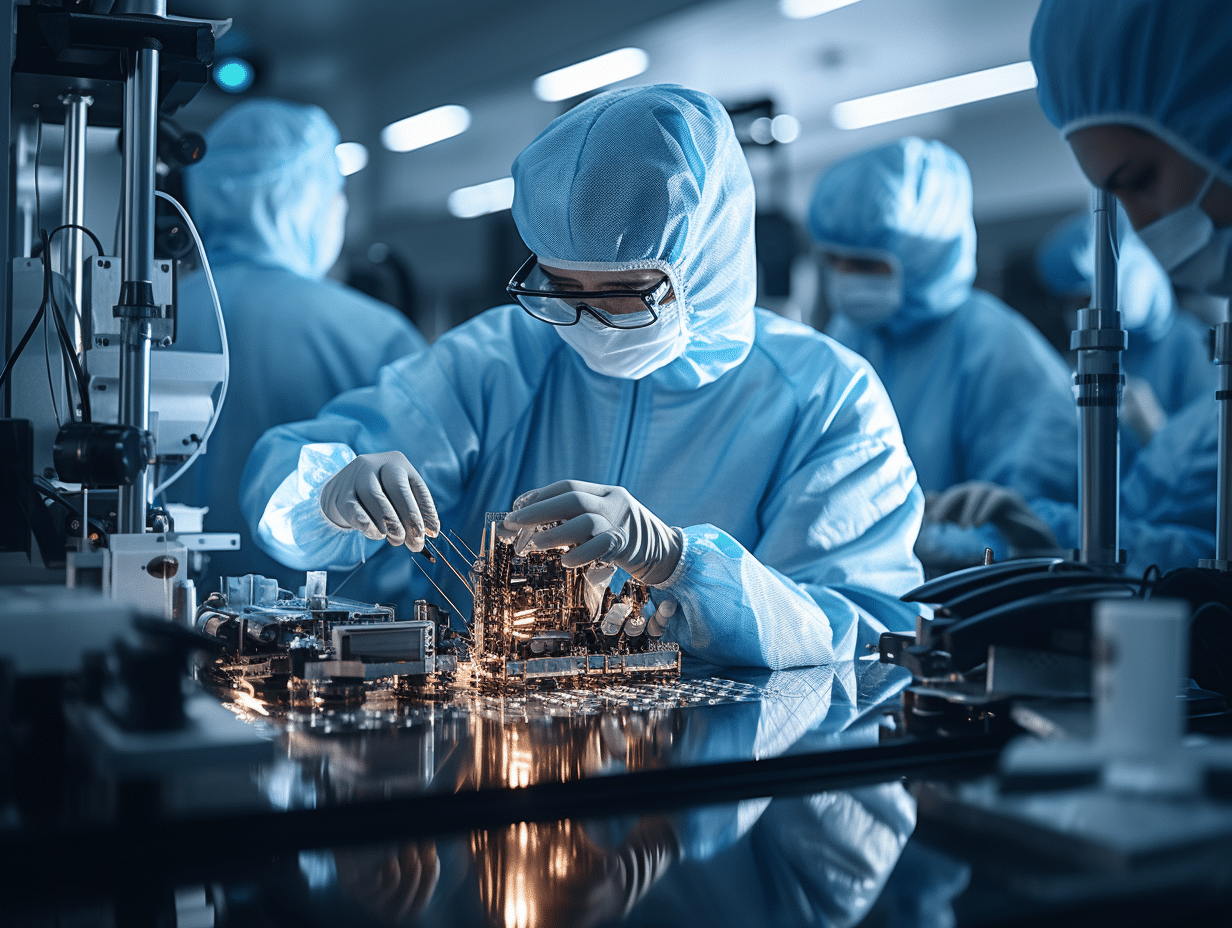

Les robots et les systèmes automatisés, qui semblent tout droit sortis de la science-fiction, sont déjà une réalité dans certaines industries. L’agence de projet de recherche avancée de défense des États-Unis, plus connue sous le nom de DARPA, travaille sur des projets de robotique et d’autonomie qui pourraient, à terme, changer la face des conflits armés et des interventions militaires. Ces développements posent inévitablement la question de l’encadrement et du contrôle de ces technologies, afin de prévenir toute dérive susceptible de compromettre l’intégrité et la sécurité des citoyens.

Face à ces enjeux, la communauté internationale se mobilise pour définir des cadres éthiques et légaux aptes à réguler le développement et l’utilisation de l’IA. La sécurité humaine est au cœur des préoccupations, et il devient essentiel de veiller à ce que ces avancées technologiques ne se retournent pas contre la société qu’elles sont censées servir. Suivez les débats et les propositions législatives en cours, car elles façonneront l’évolution de l’intelligence artificielle dans les années à venir et détermineront la place que ces technologies occuperont dans notre futur.

Les cadres de régulation pour une IA sécurisée et éthique

Dans un contexte où la fiction se mêle parfois dangereusement à la réalité, la régulation de l’IA s’impose comme une nécessité pour prévenir les scénarios catastrophes. La National Security Agency (NSA) elle-même, qui a nommé l’un de ses programmes de surveillance ‘Skynet‘, souligne paradoxalement l’urgence de mettre en place des mesures de régulation efficaces. Des instances de standardisation et des comités d’éthique se penchent sur l’établissement de normes internationales pour encadrer les développements de l’intelligence artificielle et en assurer une utilisation responsable.

L’éthique se positionne au cœur du débat sur l’intelligence artificielle. La distinction entre la conscience humaine et l’intelligence des machines, bien que claire dans l’absolu, se brouille dans les perceptions. Des voix s’élèvent pour rappeler que, contrairement à des personnages tels que Skynet dans la série de films Terminator, une IA ne possède pas de conscience propre. Des scientifiques comme Brian Gogarty insistent sur le fait que l’IA, bien qu’autonome dans ses processus, reste un outil sous contrôle humain et ne devrait pas se rebeller contre ses créateurs, pourvu que des gardes-fous soient établis.

Ces gardes-fous prennent forme à travers des protocoles de sécurité robustes et des législations adaptées. La coopération internationale devient impérative pour harmoniser ces efforts de régulation. Des experts de divers domaines, à l’instar de Marie-des-Neiges Ruffo de Calabre, docteure en philosophie, apportent leur contribution en analysant l’emploi de l’IA dans un contexte militaire et en proposant des cadres éthiques pour son utilisation. Une IA sécurisée et éthique passe donc par une collaboration sans frontières, impliquant législateurs, techniciens, philosophes et citoyens.

La nécessité d’une collaboration internationale pour maîtriser l’IA

La perception omniprésente de l’intelligence artificielle comme une menace potentielle à l’humanité, renforcée par des représentations culturelles telles que Skynet dans la saga Terminator, mérite une analyse approfondie. Considérez l’IA non comme une entité dotée d’une conscience, mais comme un ensemble de systèmes et d’algorithmes conçus pour résoudre des problèmes spécifiques. Le scientifique Brian Gogarty rappelle que l’IA, dépourvue de volonté propre, ne devrait pas, en théorie, se rebeller contre ses concepteurs.

Les progrès réels de l’intelligence artificielle, notamment dans les domaines de la robotique et de l’apprentissage machine, ont des implications sécuritaires qu’il ne faut pas négliger. La DARPA, agence américaine pionnière dans la recherche technologique, travaille sur des projets avancés qui pourraient transformer les champs de bataille et, par extension, la sécurité humaine. Il est donc vital de surveiller ces développements pour éviter toute dérive.

La mise en place de cadres de régulation pour une IA sécurisée et éthique est une démarche déjà amorcée par des organismes tels que la NSA. Les mesures de régulation visent à prévenir des scénarios catastrophes, non seulement en anticipant les conséquences potentielles de l’IA mais aussi en posant des limites à son développement et à son utilisation.

Dans cette perspective, la coopération internationale s’avère fondamentale pour harmoniser les efforts de régulation. Des experts de divers horizons, comme la philosophe Marie-des-Neiges Ruffo de Calabre, se penchent sur des questions éthiques fondamentales, telles que l’emploi de l’IA en contexte militaire. Leur contribution est essentielle pour établir un consensus global sur les principes éthiques qui devraient guider l’évolution de l’intelligence artificielle, renforçant ainsi la sécurité collective face à ces technologies en constante évolution.